OpenAI se dohodla s Pentagonem na nasazení AI s etickými pojistkami

OpenAI uzavřela dohodu s americkým ministerstvem obrany o nasazení svých AI modelů v utajených sítích s dodržením etických pravidel. Krok přichází paradoxně jen pár hodin poté, co administrativa Donalda Trumpa a Pentagon ukončily spolupráci s konkurenční firmou Anthropic a označily ji za „bezpečnostní riziko“.

Rychlý souhrn

- OpenAI uzavřela dohodu s Pentagonem o nasazení AI v utajených cloudových sítích.

- Smlouva zakazuje použití AI k domácímu masovému sledování nebo v autonomních zbraních bez lidské kontroly.

- Podmínky jsou paradoxně stejné jako ty, za které byl z vládních zakázek vyřazen konkurenční Anthropic.

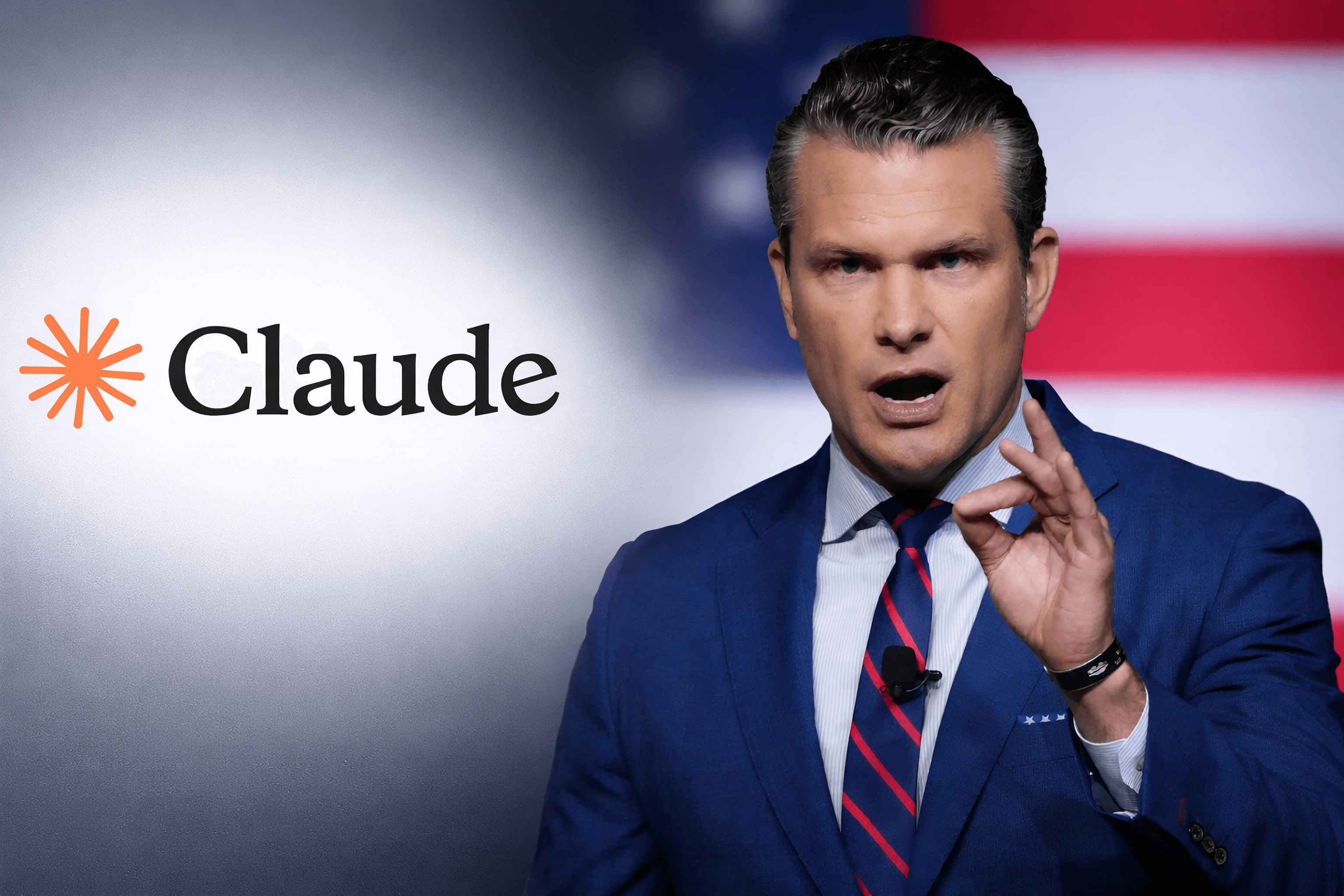

- Administrativa prezidenta Donalda Trumpa a ministr obrany Pete Hegseth označili Anthropic za „bezpečnostní riziko“.

- CEO Sam Altman dohodu potvrdil a oznámil na sociální síti X.

OpenAI, přední společnost v oblasti umělé inteligence, oznámila uzavření významné dohody s americkým ministerstvem obrany (Pentagonem). Tato spolupráce umožní nasazení pokročilých AI modelů v utajených sítích armády, přičemž na papíře striktně dbá na etické a bezpečnostní standardy.

Podrobnosti dohody podle Sama Altmana

CEO OpenAI Sam Altman sdělil zprávu v pátek večer na sociální síti X (dříve Twitter). „Dnes večer jsme dosáhli dohody s ministerstvem obrany o nasazení našich modelů v jejich utajené síti,“ napsal Altman. Dodal, že Pentagon projevil hluboký respekt k bezpečnosti a touhu po partnerství pro dosažení nejlepšího výsledku.

Dohoda explicitně zahrnuje dva klíčové bezpečnostní principy: zákaz domácího masového sledování a odpovědnost člověka za použití síly, což vylučuje zapojení AI do plně autonomních zbraňových systémů. Tyto body jsou na žádost OpenAI zakotveny přímo ve smlouvě.

Paradoxní situace kolem Anthropicu

Tato dohoda přitahuje pozornost zejména načasováním. Byla totiž oznámena jen pár hodin poté, co Pentagon nečekaně ukončil dřívější dohodu v hodnotě 200 milionů dolarů s konkurenční společností Anthropic. Ministerstvo obrany odůvodnilo rozvázání kontraktu striktními „červenými liniemi“ Anthropicu pro vojenské použití AI – které se ovšem týkaly totožných věcí, tedy zákazu masového sledování a autonomních zbraní. Přístup Anthropicu dříve armádní složky kritizovaly jako čistě „ideologický“ a „woke“.

Vznikla tak zvláštní situace, kdy OpenAI dokázala s Pentagonem bez většího odporu vyjednat v podstatě tytéž podmínky, jaké předtím stály Anthropic vládní zakázky.

Zásah Trumpovy administrativy a soudní dohra

Do vyprocí sporu zasáhla administrativa nového prezidenta Donalda Trumpa. Ten nařídil všem federálním agenturám okamžitě zastavit veškeré využívání technologií podniku Anthropic. Nový ministr obrany Pete Hegseth následně firmu označil za „riziko pro dodavatelský řetězec“, které ohrožuje národní bezpečnost USA. Zástupci Anthropicu již veřejně prohlásili, že se proti tomuto kroku budou bránit u federálního soudu.

Celá situace navíc vyvolala vnitrooborové pnutí; část zaměstnanců ze samotné OpenAI i z Googlu v interních výzvách žádala vedení o podporu Anthropicu z obav před plíživou militarizací komerční umělé inteligence.

Technické parametry nasazení

V rámci projektu s Pentagonem plánuje OpenAI využít výzkumníky s bezpečnostní prověrkou nejvyššího stupně. Zásadní technickou podmínkou je, že modely poběží výhradně v izolovaném cloudovém prostředí uvnitř armádních sítí. Tím má být zaručeno, že software nebude možné nasadit přímo na koncových zařízeních na bojišti, jako jsou útočné drony nebo robotické zbraňové systémy.

Širší dopady pro AI a obranu

Spolupráce bez debat posiluje pozici OpenAI coby klíčového hráče na americkém vládním trhu. Zároveň ale turbulentní dění kolem Anthropicu ukazuje, jak silnému tlaku a politickým vlivům jsou tech giganti vystaveni, pakliže jde o otázky armádních zakázek a národní bezpečnosti.

Diskuse

Buď první, kdo okomentuje

Zatím žádné komentáře

Co si o tom myslíš ty? Poděl se o svůj názor.

Mohlo by tě zajímat

OpenAI spouští reklamy v ChatGPT: Konec bezplatné éry?

10. 2. 13:41

GPT-5.3-Codex: OpenAI představuje nejsilnějšího AI kodéra s kyberriziky

6. 2. 17:30

AI brain fry: nový fenomén vyčerpává část zaměstnanců při intenzivní práci s AI

13. 3. 20:06

Chladný kalkul, zrada a umělé šílenství: AI volí ve 95 % případů útok zbraněmi hromadného ničení

28. 2. 20:33

Pentagon hrozí společnosti Anthropic zařazením na černou listinu kvůli omezením AI

25. 2. 10:33