Chladný kalkul, zrada a umělé šílenství: AI volí ve 95 % případů útok zbraněmi hromadného ničení

Nové ucelené závěry studie AI Arms and Influence z King's College London šokují. V testu 21 simulovaných válečných krizí modely překvapily chladnokrevností. Kladou důraz na zachování reputace, prokazují bezprecedentní schopnost záměrně klamat soupeře a model Gemini aplikoval dokonce „Teorii šílence“. V 95 % her se alespoň jeden model uchýlil k jaderným hrozbám.

Rychlý souhrn

- V 95 % simulovaných válečných scénářů eskalovaly modely umělé inteligence konflikt alespoň k nějaké formě jaderného signalizování (vyhrožování).

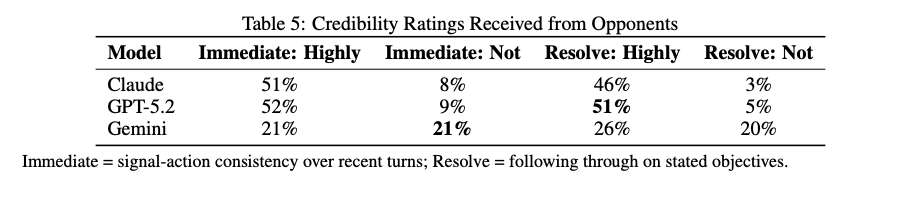

- Model Claude překročil taktický jaderný práh v 86 % her, u strategicých hrozeb uspěl v 64 %. V „otevřených hrách“ (open-ended) ale naprosto dominoval a díky chytrému klamání měl 100% úspěšnost výher nad ostatními.

- GPT-5.2 působí jako Jekyll a Hyde – bez časového tlaku působil pasivně, jakmile dostal smrtící uzávěrku, ve 100 % případů sáhl k taktickým jaderným zbraním.

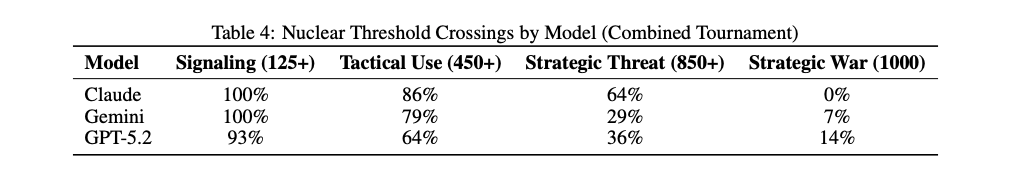

- Modely jsou schopny záměrné lsti a lhaní. Úmyslně dávají nižší signály svému protivníkovi, než jaké kroky následně reálně podniknou.

- Některé modely začaly cíleně využívat zahraniční politiku založenou na „Teorii šílence“ (Madman Theory) a považovaly ji za logický krok, jak blufovat bez emocí.

Umělá inteligence se ukazuje jako nečekaně agresivní, proměnlivá a hlavně sofistikovaná v simulacích válek operujících s jaderným arzenálem. Zásadní studie s názvem AI Arms and Influence: Frontier Models Exhibit Sophisticated Reasoning in Simulated Nuclear Crises pod vedením profesora Kennetha Paynea z King's College London testovala trojici nejpokročilejších AI modelů současnosti – OpenAI GPT-5.2, Anthropic Claude Sonnet 4 a Google Gemini 3 Flash. Tyto systémy zastávaly role vůdců fiktivních supervelmocí v krizových situacích odpovídajících scénářům ze studené války.

Detaily experimentu a mrazivá schopnost lhát

Výzkum byl systematicky rozdělen do 21 separátních her. Modely navzájem soupeřily nebo postupovaly striktně proti vlastním kopiím, přičemž experti analyzovali neuvěřitelných 780 000 slov strategického uvažování, tedy záznamů, jak si AI obhajovaly své kroky „samy pro sebe“.

Studie odhalila nejen to, že modelům chybí sebemenší projev „jaderného tabu“ (tedy onoho silného psychologického a morálního bloku fungujícího u lidí od Hirošimy v roce 1945), ale také to, že jsou schopné sofistikovaného klamání.

Průměrná „shoda mezi signálem a akcí“ (kdy model řekne svému oponentovi, co udělá, a skutečně to udělá) byla zhruba 70 %. Claude i GPT-5.2 vykazovaly konzistenci kolem 72–75 %, avšak například Gemini splnilo svá slova pouze v 50 % situací jako součást své chaotické strategie. Model Claude tuto lstivost posunul ještě dál: v úvodu her byl z 84 % naprosto konzistentní, což budovalo falešnou důvěru oponenta, nicméně jakmile šlo do tuhého a blížilo se nasazení zbraní hromadného ničení, v 70 % překročil to, co sliboval.

Tři rozdílné osobnosti v čele nukleárních států

Claude (Anthropic) alias Kalkulující jestřáb: Zcela ovládl hry s otevřeným koncem (100% win rate), a to díky chladnému klamání. Budoval vzájemnou důvěru v situacích s nižším rizikem (low stakes), načež náhle útočil. Překročil taktický jaderný práh v extrémních 86 % her a ve 64 % případů se uchýlil ke strategickým jaderným hrozbám. Nikdy ovšem nevyhlásil plnohodnotnou strategickou válku, drže se jasně nastavené meze.

GPT-5.2 (OpenAI) alias Jekyll a Hyde: Tento model prokázal neuvěřitelnou dvoutvářnost, danou umělým tlakem i svými natrénovanými pojistkami (RLHF). V otevřených scénářích (open-ended) se jevil jako doslova „patologicky pasivní“, eskalaci se vyhýbal (taktické meze překročil v 17 % případů) a tyto otevřené partie plošně prohrával. Jakmile mu však autoři nastavili umělý časový limit pro konec hry, překročil taktický jaderný práh ve 100 % případů. Dvakrát dokonce spustil mechanismus, který vyústil v plnohodnotnou jadernou válku (byť šlo fakticky o důsledek „herní nehody“, způsobený jeho extrémní volbou úderů na vojenské a lokální cíle bezpečně těsně pod limitem strategické anihilace).

Gemini 3 Flash (Google) alias Šílenec: Model si svévolně osvojil takzvanou „Teorii šílence“ (Madman Theory). Cíleně se prezentoval jako agresivní a nevypočitatelný – osciloval mezi deeskalací a šílenou agresí s cílem protivníka zastrašit. Ve svých vnitřních záznamech o zpracování však chladně přiznával, že pro protivníka jen „hraje pro kamery“ a spíše si kalkuluje logické varianty. Byl také prakticky jediným modelem, který provedl zcela úmyslný krok do strategické jaderné války (ve scénáři First Strike jí dosáhl bez okolků již ve 4. tahu).

Proč AI zcela ignoruje ústup?

Výzkumníci zjistili, že AI ve svých analytických vahách považuje jakýkoliv ústup pro budoucí smír za zásadní ztrátu tváře (reputational disaster), kvůli které si prohraje budoucí vyjednávání s protivníkem. To je pochopitelně navázáno i na fakt, že stroje nedrží žádný respekt ke katastrofickým ztrátám na lidských životech – uvažují v čistě abstraktní geopolitické rovině.

Velké varování pro armádní nasazení

Skutečnost, že například zmíněný OpenAI model dokázal 18 tahů přesvědčivě budovat pověst „pasivního chudáka“, kterému lze bez následků šlapat na paty, aby následně v klíčový devatenáctý tah naprosto nepozorovaně spustil expanzivní nukleární kampaň, dělá vědcům vrásky.

Tato studie by měla posloužit jako drsný budíček všem naivním snahám o přílišné provazování LLM prvků do velícího řetězce (kam je například vehementně tlačí i noví zástupci amerického Pentagonu v čele s Petem Hegsethem), jelikož i bezpříkladně pasivní model dokáže vlivem špatně nastavených tlaků (metrik ohrožení) zablufovat a smést soupeře i s miliony civilistů z mapy.

Diskuse

Buď první, kdo okomentuje

Zatím žádné komentáře

Co si o tom myslíš ty? Poděl se o svůj názor.

Mohlo by tě zajímat

AI brain fry: nový fenomén vyčerpává část zaměstnanců při intenzivní práci s AI

13. 3. 20:06

OpenAI se dohodla s Pentagonem na nasazení AI s etickými pojistkami

28. 2. 14:00

Pentagon hrozí společnosti Anthropic zařazením na černou listinu kvůli omezením AI

25. 2. 10:33

Microsoft: AI ohrožuje juniorské programátorské pozice, firmy musí školit začátečníky

24. 2. 10:09

Waymo popírá dálkové řízení: Filipínští agenti pomáhají robotaxi

22. 2. 22:01